OpenAI amplia la sua gamma di modelli di intelligenza artificiale con o3-mini, versione compatta della serie dedicata al ragionamento che promette prestazioni paragonabili al più grande o1 ma con tempi di risposta più rapidi e costi tecnologici inferiori. Si tratta chiaramente della risposta a Deep Seek, il modello cinese che ha fatto scalpore per il costo inferiore e l’uso di poche risorse hardware: Open AI ha infatti accusato Deek Seek di aver copiato e “ridotto” il proprio modello, e con questa mossa vuole dimostrare di poter fare un modello meno esoso in termini di risorse.

Sommario

La vera novità è l’accessibilità: per la prima volta le capacità di ragionamento avanzato saranno disponibili anche per gli utenti gratuiti di ChatGPT, segnando un passo importante nella democratizzazione dell’AI.

OpenAI o3-mini: le prestazioni superano le aspettative

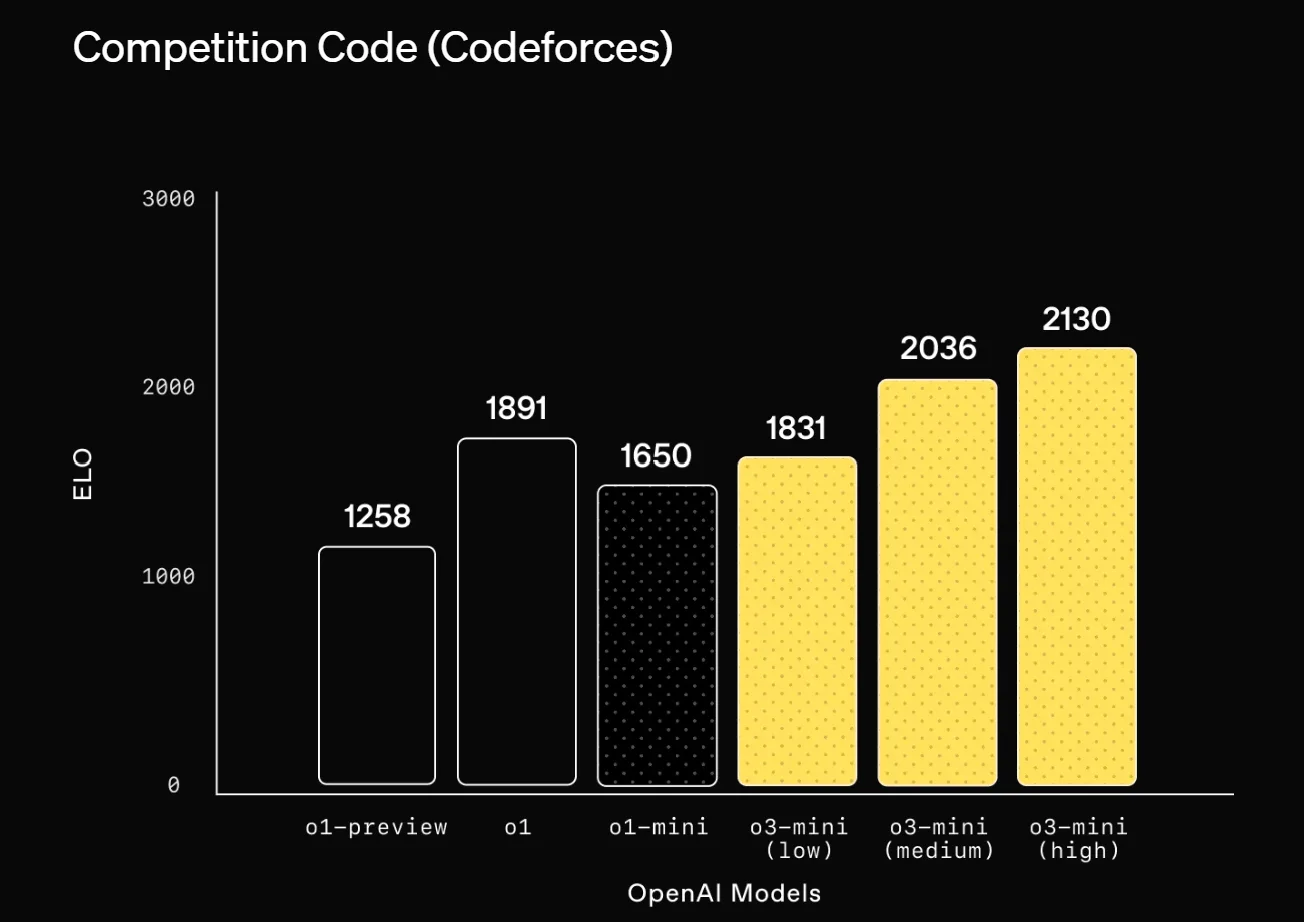

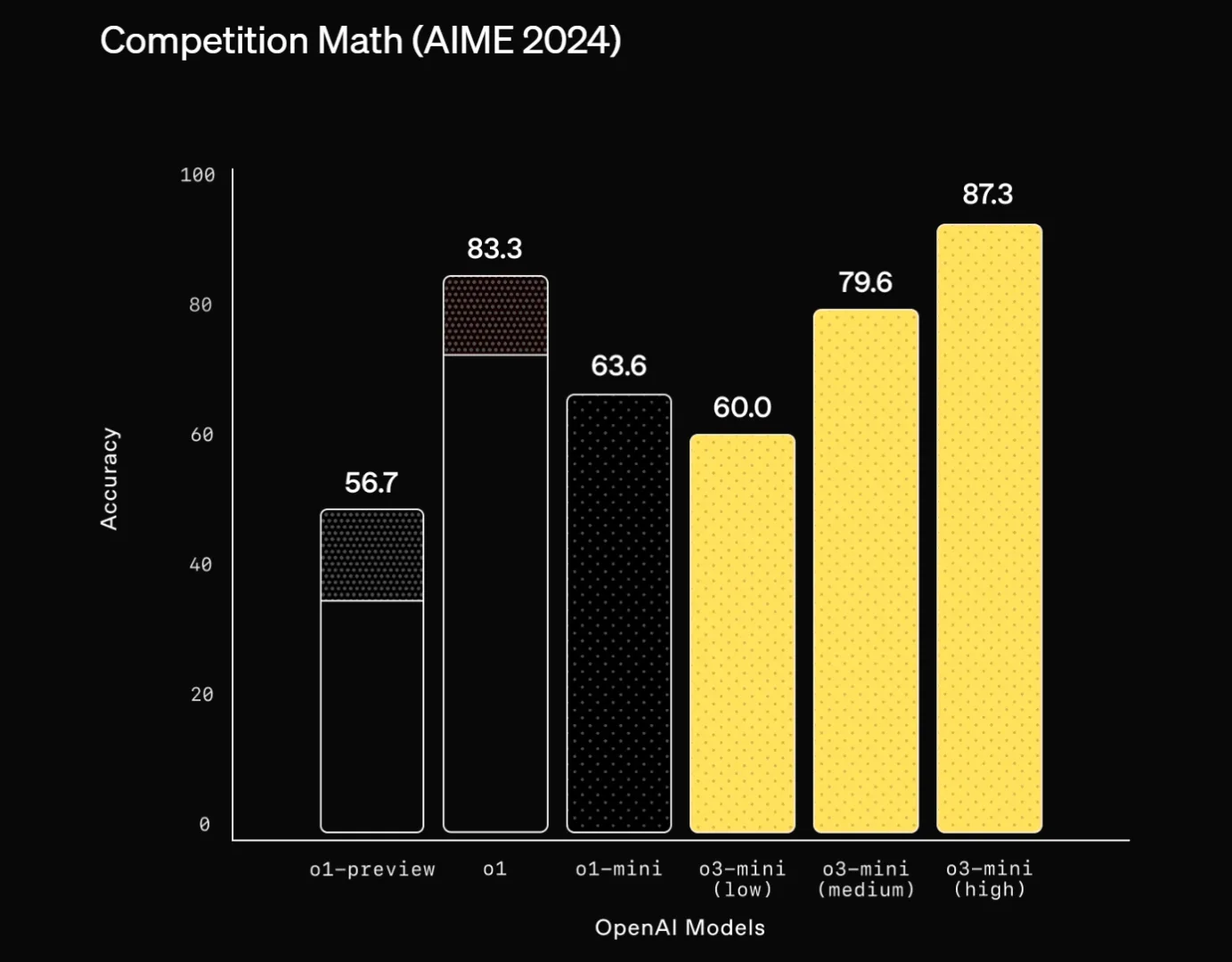

I test mostrano risultati interessanti per questa versione “mini”: risposte il 24% più veloci di o1-mini mantenendo alte performance in ambito STEM (matematica, coding, scienze). I tester esterni hanno preferito le sue risposte nel 56% dei casi, rilevando anche una riduzione del 39% negli errori gravi su domande complesse.

Nel coding, con livelli medi e alti di ragionamento, o3-mini riesce addirittura a superare il fratello maggiore o1 in alcuni task specifici, pur mantenendo latenza e costi più contenuti.

Come accedere al nuovo modello

OpenAI ha già reso disponibile o3-mini agli utenti Plus, Team e Pro di ChatGPT, mentre per Enterprise & Edu l’accesso arriverà nelle prossime settimane. Gli utenti gratuiti possono provarlo utilizzando il comando “Reason” nella chat o rigenerando una risposta esistente.

Buone notizie anche per gli abbonati Plus: il limite giornaliero dei messaggi viene triplicato passando da 50 a 150, mentre resta illimitato per gli utenti Pro.

Funzionalità per gli sviluppatori

Il nuovo modello è già integrabile nelle applicazioni attraverso le API di OpenAI (Chat Completions, Assistants e Batch). Supporta chiamate, output strutturati e streaming, ed è considerato production-ready.

Una caratteristica interessante è la possibilità di selezionare tre livelli di ragionamento (basso, medio, alto), permettendo agli sviluppatori di bilanciare prestazioni e velocità in base alle specifiche esigenze applicative.

La capacità di regolare l’intensità del ragionamento rappresenta un’innovazione significativa: permette di ottimizzare il modello per diversi scenari d’uso, dai calcoli veloci alle analisi approfondite, massimizzando l’efficienza delle risorse. Compiti poco onerosi? Basta settarlo sul livello più alto per avere maggiore velocità e risparmiare.

In breve

o3-mini rappresenta un importante passo avanti per OpenAI, combinando prestazioni avanzate con maggiore accessibilità. Il nuovo modello non solo offre risposte più veloci e accurate rispetto a o1-mini, ma porta per la prima volta le capacità di ragionamento avanzato agli utenti gratuiti. Con la sua flessibilità nei livelli di ragionamento e l’ottimo rapporto prestazioni/costo, o3-mini potrebbe accelerare significativamente l’adozione di AI avanzate sia in ambito consumer che enterprise. Tutti i dettagli nel sito ufficiale di OpenAI.